Mỗi ngày có hàng vạn các loại “bot”, lùng sục khắp internet để “cào” dữ liệu cho nhiều mục đích khác nhau. Có thể là “bot của search-engine” hay “spider”, cũng có thể “web-scrapper”, tùy từng loại chúng sẽ thực hiện các thao tác khác nhau trên website của bạn.

Có những thông tin trên website của mình, bạn không muốn “bot” nhìn thấy, và cách giao tiếp hiệu quả nhất với các con “bot” này là sử dụng một tệp nhỏ có tên là robots.txt. Nếu biết sử dụng đúng cách, robots.txt có thể hỗ trợ tối ưu chiến lược SEO của bạn.

Nhưng nếu dùng sai cách, nội dung của bạn có thể sẽ không bao giờ được “lập chỉ mục” và website của bạn gần như tàng hình trên internet.

Trong bài viết này, Tâm sẽ phân tích kỹ cho các bạn những thông tin quan trọng mà bạn cần biết về tệp robots.txt

- Ý nghĩa của robots.txt

- Khi nào bạn nên sử dụng tệp robots.txt

- Cách tạo tệp robots.txt

- Một số ví dụ về tệp robots.txt

Robots.txt là gì?

Robots.txt hay còn gọi là Tệp robots.txt, thường được đặt trong thư mục gốc của trang web, hướng dẫn các trình thu thập dữ liệu web về các trang cần loại trừ khỏi việc thu thập dữ liệu hoặc lập chỉ mục.

Tệp này rất quan trọng trong việc quản lý quyền truy cập của công cụ tìm kiếm, ngăn chặn nội dung được lập chỉ mục để duy trì quyền riêng tư, kiểm soát việc sử dụng băng thông hoặc tập trung sự chú ý của công cụ tìm kiếm vào các khu vực quan trọng của trang web.

Tệp robots.txt là một phần của nhóm các tiêu chuẩn web gọi là Giao thức Loại trừ Robots (REP) điều chỉnh cách các bot web thu thập dữ liệu của trang web đó để lập chỉ mục nội dung.

Ví dụ về tệp Robots.txt

User-agent: *

Disallow: /private/

Disallow: /restricted-page.html

Disallow: /images/

Allow: /images/public/Trong ví dụ này:

- User-agent: * là ký tự đại diện áp dụng các quy tắc cho tất cả các trình thu thập dữ liệu web hoặc robot.

- Disallow: chỉ định các thư mục hoặc tệp không nên được thu thập dữ liệu. Ví dụ: thư mục /private/ và tệp /restricted-page.html là không được phép.

- Allow: được sử dụng để ghi đè một quy tắc Disallow. Trong trường hợp này, mặc dù toàn bộ thư mục /images/ không được phép, nhưng thư mục con /images/public/ được phép.

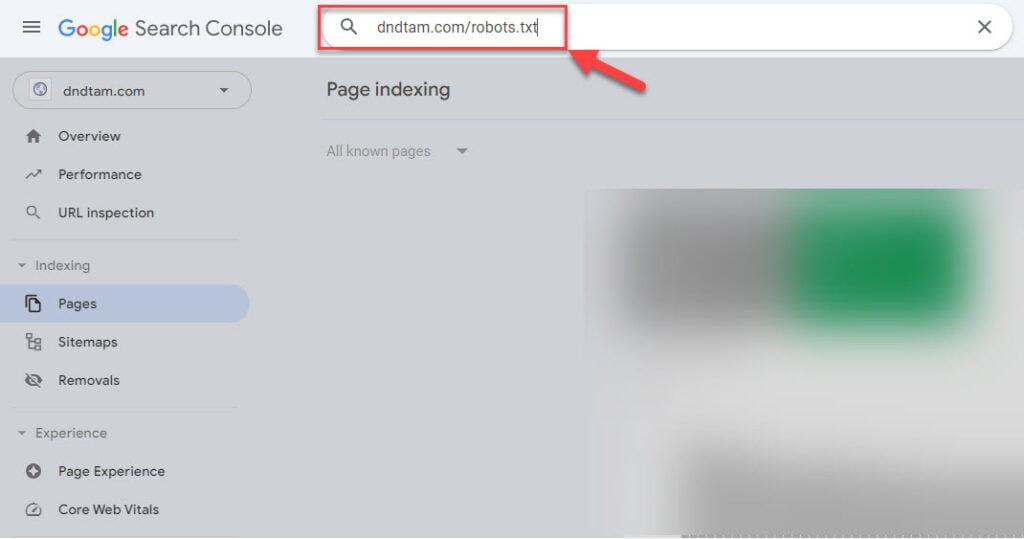

Cách tìm tệp robots.txt

Tìm tệp robots.txt của một trang web rất đơn giản. Chúng ta có thể truy vấn nó bằng cách gõ URL của trang chủ của trang web và thêm “/robots.txt.”

Ví dụ:

Tại sao bạn cần một tệp robots.txt?

Theo kinh nghiệm của Tâm, bạn nên xem viêc tối ưu tệp robots.txt như một phần của quá trình Audit Website (quá trình kiểm tra toàn diện một website khi tiến hành các chiến dịch SEO). Nếu bạn không tối ưu tệp này, bot của Google và các loại bot khác sẽ thu thập tất cả các dữ liệu của trang web, kể cả các thông tin liên quan đến “back-end” – phần thông tin liên quan đến quá trình quản trị trang web.

Bạn cần tối ưu tệp robots.txt nếu bạn muốn kiểm soát nhiều hơn và sâu hơn những thông tin mà công cụ tìm kiếm thu thập trên trang web của bạn.

Một vài trường hợp bạn nên sử dụng robots.txt

- Tối ưu hóa ngân sách thu thập dữ liệu: Mỗi trang web có một ngân sách thu thập dữ liệu, nghĩa là trong một khung thời gian nhất định, Google sẽ thu thập dữ liệu một số lượng trang giới hạn trên một trang web. Nếu trang của bạn có quá nhiều nội dung không cần indexed, bạn nên cân nhắc loại bỏ các trang này ra khỏi sitemap và khai báo lên robots.txt

- Tránh vấn đề nội dung trùng lặp: Đối với nhiều trang web, nội dung trùng lặp là điều không thể tránh khỏi.

Ví dụ: Tâm đang set-up một trang web thương mại điện tử và Tâm có nhiều trang sản phẩm có khả năng xếp hạng cho một từ khóa chung. Tâm có thể dùng Robots.txt để loại bỏ các trang có nội dung ít liên quan nhất để tránh trùng lặp. - Ưu tiên nội dung quan trọng: Bằng cách sử dụng trường chỉ thị [Allow:], bạn có thể cho phép các công cụ tìm kiếm thu thập và lập chỉ mục nội dung quan trọng trên trang web của mình.

- Ngăn chặn lập chỉ mục các khu vực quản trị hoặc thử nghiệm: Nếu trang web của bạn có các khu vực quản trị (ví dụ: /admin, /log-in,) hoặc thử nghiệm mà bạn không muốn lập chỉ mục, sử dụng chỉ thị [Disallow:] trong tệp robots.txt có thể giúp ngăn chặn công cụ tìm kiếm lập chỉ mục các khu vực này.

Robots.txt hoạt động như thế nào?

Tệp robots.txt thông báo cho các bot của công cụ tìm kiếm biết những trang nào cần bỏ qua và những trang nào cần ưu tiên. Để hiểu điều này, trước tiên chúng ta hãy khám phá các bot làm gì.

Cách bot của công cụ tìm kiếm và lập chỉ mục nội dung

Công việc của một công cụ tìm kiếm là tổng hợp nội dung, phân tích nội dung và trả kết quả cho người “tìm kiếm” . Để làm điều này, các bot hoặc spider của công cụ tìm kiếm phải tìm và khám phá nội dung bằng cách truy cập và phân tích nội dung các website trên internet gần như liên tục. Quá trình này được gọi là thu thập dữ liệu.

Tác động của tệp robots.txt đến việc thu thập dữ liệu và lập chỉ mục

Khi một bot truy cập vào một trang web, nó sẽ kiểm tra xem có tệp robots.txt hay không để xác định cách thu thập dữ liệu và lập chỉ mục trang web đó. Nếu tệp này có, nó cung cấp hướng dẫn về việc thu thập dữ liệu.

Nếu không có tệp robots.txt hoặc thiếu hướng dẫn thu thập dữ liệu, bot sẽ tiến hành thu thập dữ liệu toàn bộ nội dung trang web mà nó tìm thấy.

Ví dụ về các chỉ thị trong robots.txt

User-agent: *

Disallow: /private/

Allow: /public/

Disallow: /restricted/Trong ví dụ này:

- User-agent: * áp dụng các quy tắc cho tất cả các trình thu thập dữ liệu web.

- Disallow: /private/ hướng dẫn tất cả các trình thu thập dữ liệu web tránh thu thập dữ liệu thư mục /private/.

- Allow: /public/ cho phép tất cả các trình thu thập dữ liệu web thu thập dữ liệu thư mục /public/, mặc dù có một directive Disallow rộng hơn.

- Disallow: /restricted/ tiếp tục ngăn chặn việc thu thập dữ liệu của thư mục /restricted/.

Tìm hiểu về cú pháp của robots.txt

Tệp robots.txt thông báo cho công cụ tìm kiếm cách thu thập thông tin bằng cách sử dụng các Chỉ thị (Directive). Chỉ thị là một dạng câu lệnh cung cấp thông tin cho hệ thống (trong trường hợp này là bot công cụ tìm kiếm) về cách hành xử.

Mỗi chỉ thị bắt đầu bằng cách trước tiên chỉ định tác nhân người dùng (User-agent), sau đó đặt quy tắc cho tác nhân người dùng đó.

Tác nhân người dùng đề cập đến ứng dụng hoạt động thay mặt người dùng khi tương tác với hệ thống hoặc mạng. Trong trường hợp của Tâm, tác nhân người dùng đề cập đến trình duyệt web.

Ví dụ:

User-agent: Googlebot (dành cho Googlebot)

User-agent: Bingbot (dành cho Bingbot)

User-agent: * (dành cho tất cả các “user”)

Dưới đây, là những chỉ thị (directive) Tâm sử dụng nhiều và được hỗ trợ bởi các “bot” – tức là “bot” xem và hiểu được các chỉ thị này.

Disallow: chỉ thị này này ngăn công cụ tìm kiếm thu thập dữ liệu các khu vực nhất định của trang web. Bạn có thể:

- Chặn quyền truy cập vào tất cả các thư mục đối với tất cả tác nhân người dùng.

User-agent: *

Disallow: / - Chặn một thư mục cụ thể cho tất cả các tác nhân người dùng.

User-agent: *

Disallow: /bi-mat - Chặn quyền truy cập vào tệp PDF hoặc bất kỳ tệp nào khác đối với tất cả tác nhân người dùng bằng cách sử dụng phần mở rộng tệp thích hợp.

User-agent: *

Disallow: *.pdf

Allow: chỉ thị này cho phép các công cụ tìm kiếm thu thập dữ liệu một trang hoặc thư mục. Sử dụng lệnh này để ghi đè lệnh không được phép. Các bạn có thể xem ví dụ bên dưới, Tâm đã chặn các công cụ tìm kiếm thu thập dữ liệu thư mục /bi-mat nhưng cho phép chúng truy cập vào thư mục con /cho-phep trong thư mục /bi-mat.

User-agent: *

Disallow: /bi-mat

Allow: /bi-mat/cho-phep

Sitemap: Bạn có thể chỉ định vị trí sitemaps (Sơ đồ trang web) của mình trong tệp robots.txt. Sơ đồ trang web là một tệp trên trang web của bạn cung cấp danh sách URL có cấu trúc để hỗ trợ các công cụ tìm kiếm cách thu thập dữ liệu trang web của bạn.

Sitemap: https://dndtam.com/sitemap.xml

Nếu bạn muốn hiểu thêm về các chỉ thị và lệnh, hãy xem hướng dẫn về robots.txt của Google tại đây: Cách viết và gửi tệp robots.txt

Sử dụng ký tự Wildcards

Ký tự wildcards là các ký tự bạn có thể sử dụng để cung cấp các lệnh áp dụng cho nhiều URL cùng một lúc. Hai ký tự đại diện chính được sử dụng trong tệp robots.txt là dấu hoa thị (*) và ký hiệu đô la ($).

Bạn có thể sử dụng chúng để áp dụng các chỉ thị hoặc cho tác nhân người dùng.

Ví dụ:

- Dấu hoa thị – Asterix (*): Khi áp dụng cho tác nhân người dùng, ký tự đại diện có nghĩa là “áp dụng cho tất cả tác nhân người dùng”. Khi áp dụng cho URL, nó có nghĩa là “áp dụng cho tất cả các URL”. Nếu bạn có các URL theo cùng một mẫu, điều này sẽ giúp bạn tiết kiệm thời gian.

- Ký hiệu đô la – Dollar sign ($): Ký hiệu đô la được sử dụng ở cuối mẫu URL để khớp với các URL kết thúc bằng một chuỗi cụ thể.

User-agent: *

Disallow: *.pdf$Trong ví dụ vừa rồi, Tâm đang chặn công cụ tìm kiếm thu thập dữ liệu tất cả các tệp PDF.

Cách tạo tệp robots.txt

Nếu trang web của bạn không có tệp robots.txt, bạn có thể dễ dàng tạo một tệp trong trình soạn thảo văn bản. Chỉ cần mở một tài liệu .txt trống và chèn các chỉ thị của bạn. Khi hoàn thành, lưu tệp dưới dạng ‘robots.txt’, vậy là bạn đã có một file robots.txt.

Tiếp theo là cách upload (đăng tải) nó lên website của bạn.

Về lý thuyết, bạn có thể đặt nó vào bất kỳ thư mục chính nào trên trang web của mình, nhưng để đảm bảo bot tìm thấy nó, Tâm khuyên bạn nên tải nó lên thư mục gốc.

Đảm bảo rằng nó có thể truy cập được thông qua trình duyệt web tại đường dẫn https://tenmiencuaban.com/robots.txt. Nếu muốn kiểm tra mức độ hiệu quả của tệp robots.txt, bạn có thể kiểm tra bất kỳ URL nào bằng công cụ Kiểm tra URL của Google Search Console.

Những sai lầm thường gặp cần tránh

- Chặn nội dung quan trọng: Bằng cách sử dụng các quy tắc quá hạn chế, bạn có thể vô tình hạn chế các phần quan trọng của trang web của mình.

- Chặn các tệp CSS, JavaScript và hình ảnh: Một số công cụ tìm kiếm sử dụng các tài nguyên này để hiểu cấu trúc của trang web của bạn.

- Phân biệt chữ hoa chữ thường không đúng: Các tệp robots.txt phân biệt chữ hoa chữ thường.

- Giả định bảo mật thông qua robots.txt: Nội dung nhạy cảm nên được bảo vệ bằng các phương tiện khác vì robots.txt chỉ là một hướng dẫn và không đảm bảo rằng các trang sẽ không được lập chỉ mục.

- Cú pháp không đúng: Xác thực các tệp của bạn vì các lỗi đánh máy có thể dẫn đến việc các công cụ tìm kiếm hiểu sai tệp robots.txt của bạn.

Robots.txt: Tổng kết

Tâm hy vọng qua bài viết này các bạn đã hiểu hết về robots.txt . Bạn biết nó là gì, nó hoạt động như thế nào và cách sử dụng nó để tăng cường chiến dịch SEO của bạn. Chỉ cần nhớ luôn xem xét và kiểm tra tệp robots.txt của mình.

Hãy sử dụng tệp robots.txt một cách khôn ngoan, vì nó như con dao hai lưỡi, dùng sai bạn có thể mất rất nhiều thời gian để sửa.

Câu hỏi thường gặp

Tệp robots.txt là gì?

Robots.txt là một tệp văn bản nằm trong thư mục gốc của một trang web và được sử dụng để thông báo cho các trình thu thập dữ liệu web cách thu thập dữ liệu và lập chỉ mục trang web.

Làm thế nào để xem tệp robots.txt?

Cách dễ nhất để truy cập tệp robots.txt là gõ URL của trang web vào trình duyệt và sau đó thêm /robots.txt vào cuối. Nó sẽ trông như thế này: https://www.example.com/robots.txt.

Robots.txt có tốt cho SEO không?

Tệp robots.txt đóng vai trò quan trọng trong SEO. Mặc dù nó không ảnh hưởng trực tiếp đến xếp hạng của một trang web, nhưng chúng giúp các công cụ tìm kiếm hiểu cấu trúc của trang web và các trang nào cần được bao gồm hoặc loại trừ khỏi chỉ mục của website đó.

Khi nào bạn nên sử dụng tệp robots.txt?

Sử dụng tệp robots.txt để kiểm soát việc thu thập dữ liệu của công cụ tìm kiếm. Hạn chế các khu vực nhạy cảm, ngăn chặn việc lập chỉ mục nội dung trùng lặp, quản lý ngân sách thu thập dữ liệu và hướng các bot tránh xa nội dung không cần thiết hoặc riêng tư.